李彦宏说的「MCP」,还有人不知道吗?

文|邓咏仪

编辑|苏建勋

大模型的风,如今又刮到了一个新名词上:MCP。

AI 圈中不缺新鲜事,但这次不一样,互联网仿佛又回到了十多年前的春天。" 现在,基于 MCP 开发智能体,就像 2010 年开发移动 APP。"4 月 25 日,百度董事长李彦宏在百度 Create 大会上说到。

如果还没有听过 MCP,但你肯定听过上一个热词:Agent(智能体)。2025 年初,中国初创公司 Manus 的爆火,把这个名词瞬间推到了大众面前。

" 真 · 能干活的 AI",是 Agent 爆火的关键。在这之前,大模型可以答疑解惑,但它只是一个简单的对话窗口,依赖于模型接受过的训练,大模型内的数据往往不是最新的,如果只有大模型本体,调用外部工具,要经历非常繁琐的过程。

MCP 这个概念,就和 Agent 密不可分。MCP 是 Agent 愿景得以实现的的重要路径——大模型可以自由地调用支持 MCP 协议的外部工具,完成更具体的任务。

现在,包括高德地图、微信读书在内的应用,就已经纷纷推出官方的 MCP Server(服务器),这意味着,所有开发者都可以像搭积木一样,先确定自己用什么大模型,而后调用高德地图、微信读书的 MCP 服务器,大模型就可以完成查询地图等等任务。

从 2 月开始,一场 MCP 浪潮已经如火如荼地席卷全球。

几乎所有大厂—— OpenAI、谷歌、Meta,以及国内的阿里、腾讯、字节、百度等等,纷纷宣布支持 MCP 协议,也都推出了自家的 MCP 平台,邀请各路开发者、应用服务商进驻。

如果复盘 2024 年国内 AI 领域讨论得最火的名词," 超级应用 " 肯定算其中一个。人们普遍认为,2024 年会迎来 AI 应用的大繁荣,但并没有如预期般快速发展。AI 领域的创新生态,更多还是星星点点地散落在各处。

正因如此,MCP 的爆火,不亚于春秋战国时期,秦始皇一扫六合的意义——统一各国的书写、交通、度量标准,从而大大方便了经济和商品往来。

不少市场评价认为,随着 MCP 等协议逐渐成为共识和趋势,2025 年会迎来一场真正意义上的 AI 应用大爆发。

MCP,AI 的 " 超级外挂 "

事实上,MCP 并不是一个新事物,早在 2024 年 11 月,就已经由 Anthropic 宣布推出。

MCP 的全称是 "Model Context Protocol",即模型上下文协议。这是一项开放标准,基于大模型的应用如果支持了 MCP 协议,就像学会了一门标准化 " 语言 ",和外界的数据源、工具等等进行互动。

如果你觉得这个解释依然复杂,那么可以看看手机、电脑上的数据接口—— MCP 相当于给大模型装上了一个 " 万能插座 ",定义了一个标准的 "USB 接口 "。

有了这个接口,开发者得以有章法地,在更标准化的框架和约定下进行应用开发,对接不同的数据源和工作流。

在 MCP 成为趋势之前,开发 AI 应用的门槛一直在高位。

如果一位开发者想开发一个 AI 旅游助手,需要让大模型至少完成几项工作:查看地图、在网络上查找攻略、结合用户需求撰写一份新的旅游计划。

那么,为了让大模型顺利能够查询地图,在浏览器上查找现有的攻略。开发者所经历的开发过程是这样的:

首先,每个 AI 提供商(OpenAI、Anthropic 等)对 Function Calling 的实现略有不同。如果中间涉及两个大模型的切换,那开发者还需要为不同模型重写适配代码,相当于帮大模型写一个外部工具的 " 使用手册 ",大模型才能学会用更好的 Prompt 调用外面的工具。否则,模型输出的结果准确度会直线下降。

简单总结,就是大模型在和外界交互时,缺少统一标准,导致代码复用性太低。AI 应用生态的发展就会自然滞后。

" 对于任何一个大模型应用开发者,在 MCP 出现之前,开发者不仅需要懂大模型,也需要自己做二次开发,把外部的工具嵌入到自己的应用中。并且,工具的性能如果不好,开发者自己还需要去研究,究竟是应用本身的问题,还是工具的问题。" 阿里云魔搭社区算法技术专家陈子谦对《智能涌现》等媒体表示。

Manus 也是一个典型例子。不久前,《智能涌现》也曾对 Manus 进行测评,哪怕只是写一篇简单的新闻,Manus 很容易就需要调用十多种工具,比如开启浏览器,浏览和抓取网页、进行写作、验证和交付最终结果。

在每个环节里,如果 Manus 选择要调用外部工具,那么就需要编写一个 " 函数 ",用来安排外部的工具如何运行。结果就是,Manus 常常因为任务过载而中止任务,也是因为单个任务所消耗的 Token 太多了。

但在 MCP 之后,最核心的转变就是:开发者不需要对外部工具的性能负责,只需要对应用本身做维护和调试,大大减少了开发工作量。

相对应的,生态中的一个个单点 Server,则会维护好自己的 MCP 服务——比如支付宝、高德地图等等应用方,维护好自己的 MCP 服务器,更新到最新版本,等待开发者来接入即可。

不过,MCP 生态还相当早,现在也远不是一个完美方案。已经有不少开发者表示,MCP 有点为建标准而建—— API 也许是更简洁的方案。而如果 MCP 服务器并非官方推出,也没有人精心维护,那么接入 MCP 的的安全性、服务稳定性也不容乐观。

尽管如此,MCP 可以说是第一个真正意义上爆火出圈的调用工具协议,它的效应也在快速显现。据 MCP 社区 PulseMCP 统计,全球已经有超过 4000 个 MCP 服务器上线,而这一数字还在迅速增长中。

听上去很理想,但 MCP 生态还相当早,现在也远不是一个完美方案。

已经有不少开发者表示,MCP 有点为了建立标准而建——在那之前,API 已经是更简洁的方案了,大模型也已经可以通过很多协议调用 API,MCP 有一种画蛇添足之感。

现在大公司们发布的 MCP 服务,基本都由厂商自己定义,可以被 LLM 调用什么功能,以什么样的方式调度。但同样的问题也会出现在 MCP 上——大公司很大概率不会把最核心、最实时的信息给你。

而如果 MCP 服务器并非官方推出,也没有人精心维护,那么接入 MCP 的的安全性、服务稳定性也不容乐观。

独立开发者唐霜就分享了自己遇到的案例:某度地图的 MCP Server,工具不足 20 个,有 5 个要求传入经纬度,再来一个查天气,要求用户提供行政区划 ID 来查询天气,但却没有提供如何获取这些 ID 的方法或文档。解决方案只能是用户回到这一服务商的生态中,按部就班获取信息与权限

如此看来,MCP 的爆火只是表面,但背后的博弈远未结束——大模型厂商虽愿意提供 MCP 服务,但主动权仍然抓在厂商手中,没有人愿意为 Anthropic 的生态做嫁衣。如果没有心思好好提供服务,开发者反倒要做双倍的工作,这个生态的逻辑也不会存在。

开放路线的再一次胜利

不过,为什么 MCP 现在才火起来?

在 Anthropic 刚推出 MCP 协议的初期,其实关注者寥寥。当时,只有有限的应用支持 MCP 协议,比如 Anthropic 自家的 Claude Desktop。开发者们也没有形成一个统一的 AI 开发生态,基本属于各自闭门造车的状态。

是因为开发者群体的接纳,MCP 才开始慢慢走到舞台中心。2025 年 2 月开始,AI 编程领域的一众明星应用——包括 Cursor、VSCode、Cline 等等,纷纷宣布支持 MCP 协议,这让 MCP 协议声名鹊起。

在开发者群体中掀起声浪之后,真正引爆 MCP 协议的,是大模型厂商们的接入。

关键性的一步,无疑是 3 月 27 日,OpenAI 宣布支持 MCP 协议,紧随其后的则是 Google。

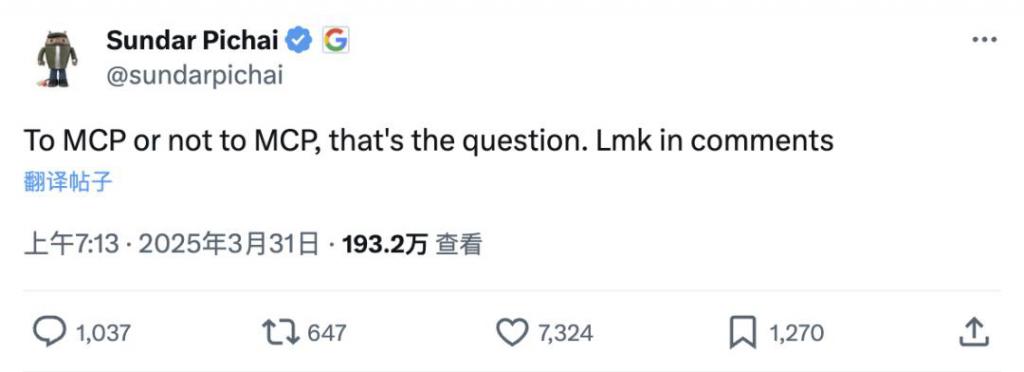

Google CEO 桑达尔 · 皮查伊曾在 X 上表达过对 MCP 的纠结。3 月 31 日,他发了条推特,表示:" 接入 MCP 还是不接入 MCP,这是个问题。" 但发完这条推特短短 4 天后,Google 也宣布接入 MCP。

△来源:X(Twitter)

大厂们最终都选择拥抱 MCP,这和 DeepSeek 冲击硅谷的故事异曲同工:接入 MCP,本质上也是大模型厂商在生态战略上的转向——与其各自为政,不如求同存异,拥抱一套更开放的协议,集体把蛋糕做大。

过去两年中,大模型厂商在 AI 战略的布局上,往往都还是想圈占地盘为主。这个逻辑和互联网的发展历史别无二致,比如苹果,成为平台厂商,建立起强大的开发者生态,而非单纯提供单点的产品服务,才能逐步建立起垄断性的优势。

OpenAI 也是学着苹果这么做的。

在接入 MCP 协议之前,OpenAI 开发者生态的路线,总体从开放逐渐走向封闭。ChatGPT Plugins 在 2023 年 3 月上线,当时的 Plugins,还允许第三方开发者为 ChatGPT 添加特定功能,也支持同时使用多个插件,是一个较为开放的扩展生态系统。

但在 2024 年 1 月推出 GPTs 及商店后,OpenAI 很快终止了 Plugins 的服务。GPTs 被设计成一个更封闭的商店模式—— GPTs 只能在 OpenAI 平台上运行,从模型到应用全部由 OpenAI 控制,通过平台抽成获利。而开发者也需要针对 ChatGPT 这一个平台开发,开放程度相当有限。

截至目前,OpenAI 的 GPTs 生态效果并不如人意,商店中充斥着大量低质的简单套壳应用,商业化闭环也远未跑通。

Anthropic 的 MCP 协议,很多思路也并非行业首创。OpenAI 推出的 Function Calling,其实同样是大模型调用外部工具的一个主流标准,MCP 的许多技术思路,也和 Function Calling 一脉相承。

但 MCP 在产品层面做得更用户友好。Function Calling 的问题在于,开发者还需要做二次编程和大量的适配工作,但 MCP 让服务方将这些需求打包成一个个的 " 乐高积木 ",大大降低了 AI 应用的开发门槛。

而且,MCP 还拥有一个最核心的优势:它更开放、抽象程度更高。MCP 只是一个网络协议,并且没有对底层的模型作限制,任何 AI 模型或平台,都可以基于 MCP 进行交互,也适用于云端或本地的多种部署形式。

MCP 足够开放,也并不会让任何一家大厂独大,这大厂们都能找到一个比较舒服的位置和心态,接入这套协议。

某种程度上,这也是 Anthropic 用更开放的姿态,以夺回开发者生态的尝试—— OpenAI 的封闭战略,则再一次被证明是战略上的误判。对于仍处早期的前沿科技行业而言,从 DeepSeek 到如今的 MCP,无一不告诉我们:开放、开源的路线,依旧是当下的最优解。

欢迎关注

欢迎交流

本文来自微信公众号" 智能涌现 ",作者:邓咏仪,36 氪经授权发布。